Por Sharon Zhang

Este artículo fue publicado originalmente por La verdad

El director ejecutivo de Anthropic ha expresado su preocupación por el uso de IA para vigilancia y drones autónomos.

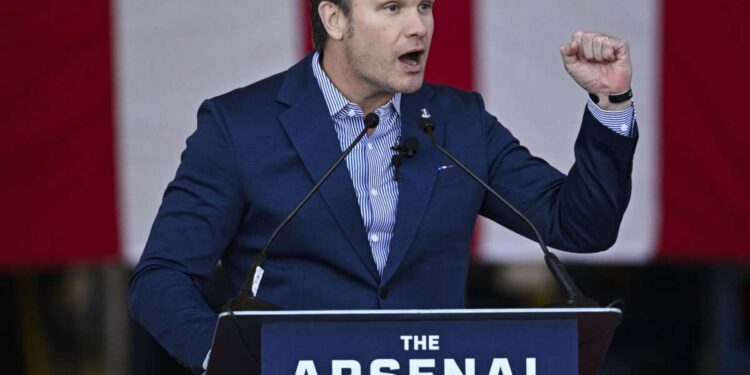

El secretario de Defensa, Pete Hegseth, ha amenazado a Antropic con incluirla en la lista negra si la empresa de inteligencia artificial se niega a permitir que sus herramientas se utilicen para ataques con drones autónomos o vigilancia masiva, una muestra escalofriante de las prioridades del Pentágono.

En una reunión con la empresa el martes, Hegseth dijo que la empresa debe levantar sus exigencias de restricciones de seguridad antes del viernes a las 17:01 horas. De lo contrario, advirtieron los funcionarios, el Pentágono declarará a la empresa un “riesgo para la cadena de suministro” y la incluirá efectivamente en la lista negra o, paradójicamente, invocará la Ley de Producción de Defensa para obligar a Antropic a cumplir.

Fuentes familiarizadas con la reunión dijeron que los representantes de la compañía en la reunión expresaron preocupaciones de seguridad sobre la capacidad de la IA para controlar armas de manera confiable. Según informaron a los funcionarios, la falta de regulaciones sobre el uso de la IA en la vigilancia masiva también podría plantear riesgos.

El director general de la empresa, Dario Amodei, ha expresado repetidamente su preocupación por estas cuestiones.

«Me preocupa el enjambre de drones autónomos, ¿verdad? Las protecciones constitucionales en nuestras estructuras militares dependen de la idea de que hay humanos que, esperamos, desobedecerían órdenes ilegales. Con armas totalmente autónomas, realmente no tenemos esas protecciones», dijo Amodei en una entrevista con el podcaster Wes Roth.

A Amodei también le preocupa que la IA pueda acceder y procesar conversaciones privadas capturadas por tecnología dentro de los hogares de las personas que podrían usarse para etiquetarlas políticamente y “socavar” la Cuarta Enmienda.

Sin embargo, Anthropic anunció después de su reunión con Hegseth que abandonará una política de seguridad central que pondría barreras a su desarrollo de IA para mitigar los riesgos que la IA representa para la sociedad. No está claro si los cambios están relacionados con las demandas del Pentágono, pero el momento genera sospechas.

Los expertos legales han dicho que no está claro si la administración Trump podría usar la Ley de Producción de Defensa para obligar a Anthropic a actuar.

Anthropic está en negociaciones para un contrato con el Pentágono y, según se informa, anteriormente se ofreció a permitir que sus sistemas de inteligencia artificial se utilicen para defensa cibernética y antimisiles. Sin embargo, el Pentágono dice que la empresa debe permitir el uso de sus herramientas para todos los fines militares.

Según los informes, el Pentágono utilizó el modelo de IA de la compañía, Claude, durante su operación para bombardear Caracas y secuestrar al presidente venezolano Nicolás Maduro, una operación que mató a 83 personas, incluidos civiles. A Diario de Wall Street El informe, citando fuentes familiarizadas, dijo que el Pentágono hizo uso de Claude a través de la asociación de Anthropic con Palantir, que tiene un contrato con el gobierno de Estados Unidos.

Un funcionario del Pentágono dijo en un comunicado que las demandas de Hegseth “no tienen nada que ver con la vigilancia masiva y el uso de armas autónomas”, pero la administración Trump ha trabajado tenazmente para sobrepasar las autoridades legales e infligir más violencia y vigilancia a los estadounidenses.

«Quiero aclarar lo que significa una IA responsable en el Departamento de Guerra. Atrás quedaron los días de la IA equitativa y otras infusiones de DEI y justicia social que limitan y confunden nuestro uso de esta tecnología», dijo Hegseth durante un discurso en la sede de SpaceX en enero. «No emplearemos modelos de IA que no permitan librar guerras».

Los expertos han advertido que el uso de modelos de IA para la guerra es peligroso. Un estudio reciente en el que un investigador enfrentó los modelos ChatGPT, Claude y Gemini entre sí en 21 escenarios de guerra encontró que uno de los modelos desplegó un arma nuclear en el 95 por ciento de los juegos simulados.

Este artículo fue publicado originalmente por Truthout y tiene licencia Creative Commons (CC BY-NC-ND 4.0). Mantenga todos los enlaces y créditos de acuerdo con nuestras pautas de republicación.