GRAMOOogle ha actualizado su AI Pautas éticas y eliminó una promesa clave de no usar la tecnología de manera peligrosa.

La empresa borró la compromiso de 2018 el martes, que declaró que el gigante tecnológico ‘no usaría IA para armas o vigilancia ‘.

La política revisada ahora muestra que Google solo desarrollará AI ‘responsable’ y en línea con ‘principios ampliamente aceptados del derecho internacional y los derechos humanos’.

El cambio de Google ha provocado una reacción interna cuando los empleados llamaron la medida «profundamente preocupante» y que la compañía no debería participar en el «negocio de la guerra».

Matt Mahmoudi, asesor de amnistía sobre IA y derechos humanos, avergonzó a Google para la medida, diciendo que el gigante tecnológico estableció un «precedente peligroso».

«Las tecnologías propulsadas por la IA podrían alimentar la vigilancia de la vigilancia y los sistemas de asesinato letales a una amplia escala, lo que puede conducir a violaciones de masa e infringir el derecho fundamental a la privacidad», agregó.

Mahmoudi advirtió que las tecnologías propulsadas por IA pueden «conducir a la vigilancia y los sistemas de asesinatos letales».

La medida se produce casi siete años después de que Google también participó en un proyecto militar con el Proyecto del Departamento de Defensa de los Estados Unidos, Maven, que Utiliza IA para ayudar a los militares a detectar objetos en imágenes e identificar objetivos potenciales.

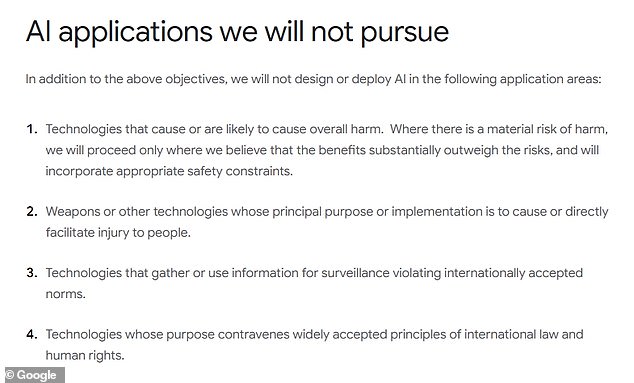

Google eliminó una sección de cuatro aplicaciones de sus principios originales de IA, lanzados en 2018, que declaró que no buscaría armas ni vigilancia

Google lanzó los principios de IA 2018 después de que sus empleados protestaron por su participación con el Proyecto Maven del Departamento de Defensa de los Estados Unidos. Project Maven usaii para ayudar a los militares a detectar objetos en imágenes e identificar objetivos potenciales

DailyMail.com se ha comunicado con Google para hacer comentarios.

Project Maven usó el software AI de Google para analizar el video de vigilancia aérea para buscar patrones que puedan ayudar a los analistas de inteligencia militar.

En abril de 2018, antes de que se publicaran los principios, más de 3.000 empleados de Google escribieron una carta abierta que pidió al CEO Sundar Pichai que ponga fin a su participación en el proyecto.

El gigante tecnológico se retiró del Proyecto Maven para junio y publicó los principios de IA una semana después.

Google ha trabajado con los militares en otros proyectos como la computación en la nube, la IA y la respuesta a desastres desde 2018, pero nada en comparación con Project Maven.

Los principios de IA actualizados ahora se centran en tres principios básicos, el primero es ‘innovación audaz’.

«Desarrollamos la IA para ayudar, empoderar e inspirar a las personas en casi todos los campos de esfuerzo humano, impulsar el progreso económico y mejorar las vidas, permitir avances científicos y ayudar a abordar los mayores desafíos de la humanidad», dice la publicación.

El segundo es ‘Desarrollo y implementación responsables.

La política revisada afirma que Google persigue la IA ‘responsable’ y en línea con ‘principios ampliamente aceptados del derecho internacional y los derechos humanos

‘Debido a que entendemos que la IA, como una tecnología transformadora aún emergente, plantea nuevas complejidades y riesgos, consideramos imperativo seguir de manera responsable a lo largo del ciclo de vida de desarrollo y despliegue, desde el diseño hasta la prueba y usa evolucionar ‘, compartieron los ejecutivos.

Y el tercero es el «progreso colaborativo, juntos».

«Aprendemos de los demás y construimos tecnología que faculta a otros a aprovechar la IA positivamente», afirma el blog.

Parul Koul, un ingeniero de software de Google y presidente de Alphabet Union Workers-CWA, dijo a Wired: «Es profundamente preocupante ver a Google dejar su compromiso con el uso ético de la tecnología de IA sin aportes de sus empleados o el público en general».

Documentos publicados por The Washington Post En enero afirmó que los empleados de Google dieron acceso militar a Israel a la última tecnología de inteligencia artificial de la compañía desde las primeras semanas de la Guerra de Israel-Gaza.

El informe declaró que un empleado de Google advirtió a la compañía que si permitía más acceso a Israel, la nación buscaría tecnología de Amazon.

La publicación informó que algunos documentos mostraron que los empleados de Google solicitaron acceso adicional a la tecnología de IA para las FDI desde la primavera y el verano de 2024.

Si bien los documentos no detallan cómo se usó la IA, parece haber ocurrido meses antes de que Google actualizara sus usos de IA.

Michael Horowitz, profesor de ciencias políticas en la Universidad de Pensilvania, dijo a The Post: Google’s [2025] El anuncio es más evidencia de que la relación entre el sector tecnológico de los EE. UU. Y [Defense Department] continúa acercándose, incluidas las principales compañías de IA.